谷歌Gemini模型发布,AI进入多模态时代

12月2日,据The Information信息,由于”无法可靠地处理一些非英语查询”,Google原定于下周举行的一系列 Gemini 发布会取消,模型的发布推迟到24年1月。

12月6日,Google官方Blog突然宣布Gemini发布。延续了PaLM 2定下的多种参数基调,Gemini分为:1)Gemini Ultra,最大、最有能力的模型,适用于高度复杂的任务;2)Gemini Pro,可扩展各种任务的最佳模型;3)Gemini Nano,高效的终端任务模型。

模型性能:Gemini在32 个学术基准中的 30 个上达到SOTA,并以90%高分成为第一个在 MMLU(大规模多任务语言理解)上超越人类专家的模型。

训练方法和能力:不同于多个多模态组件的”拼接“,Gemini是多模态原生模型,从一开始就针对不同模态进行预训练和微调,可以同时识别和理解文本、图像、音频等。

训练硬件:使用的是 Google自研的TPU v4 和 v5e,并在其AI优化基础设施上大规模训练 Gemini 1.0。

安全部署:应用Google Research对抗性测试、安全分类器、安全人工智能框架(SAIF)等技术,实现模型安全部署。

下一代大模型赋能应用与终端:当下应用遇到瓶颈,原因之一是基础模型能力尚未有本质性迭代。Google Gemini的发布,刷新了现有模型的测评结果,且原生支持多模态,为应用的跃升打下基础。此外,Google一方面延续了PaLM 2定下的多参数模型路线,另一方面在新机Pixel 8系列中加入多种AI应用,再次印证了大模型与终端结合的趋势。

作者利益披露:转载,不作为证券推荐或投资建议,旨在提供更多信息,作者不保证其内容准确性。

声明:文章观点来自网友,仅为作者个人研究意见,不代表韭研公社观点及立场,站内所有文章均不构成投资建议,请投资者注意风险,独立审慎决策。

S

万兴科技

工分

17.79

转发

收藏

投诉

复制链接

分享到微信

有用 15

打赏作者

无用

真知无价,用钱说话

0个人打赏

同时转发

评论(6)

只看楼主

热度排序

最新发布

最新互动

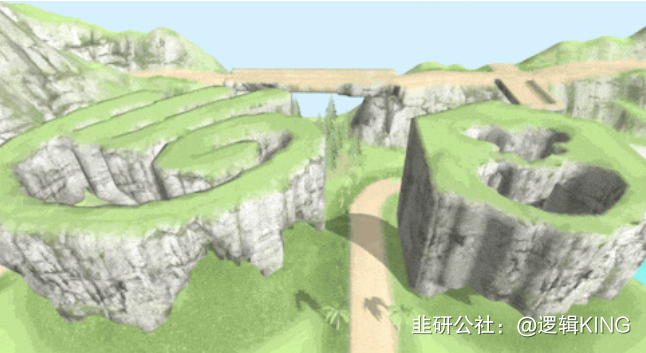

- 我们掌趣自己的也很惊艳了,给个草图加文字,直接生成UE场景动态视频

20打赏回复投诉于2023-12-07 08:33:13更新查看1条回复

20打赏回复投诉于2023-12-07 08:33:13更新查看1条回复

- 1